- Con dao hai lưỡi: Khi dữ liệu kinh doanh trở thành “thức ăn” cho AI công cộng

Năm 2026, việc sử dụng các công cụ Generative AI như ChatGPT, Claude hay Gemini đã trở thành thói quen hàng ngày của nhân viên. Tuy nhiên, một thực tế đáng ngại là nhiều người đang vô tình nạp các dữ liệu nhạy cảm như báo cáo tài chính, chiến lược kinh doanh hoặc mã nguồn phần mềm vào các mô hình AI công cộng.

Rủi ro cốt lõi: Các mô hình AI công cộng thường sử dụng dữ liệu đầu vào của người dùng để tiếp tục huấn luyện (re-training). Điều này có nghĩa là bí mật kinh doanh của bạn có thể xuất hiện trong câu trả lời của AI dành cho một… đối thủ cạnh tranh ở phía bên kia chiến tuyến.

- Những lỗ hổng an ninh mạng AI phổ biến năm 2026

Theo các chuyên gia về an ninh mạng AI, doanh nghiệp đang phải đối mặt với 3 hình thức tấn công mới:

- Prompt Injection (Tấn công bằng câu lệnh): Kẻ tấn công lừa AI bỏ qua các rào cản bảo mật để tiết lộ thông tin nội bộ được nhúng trong hệ thống.

- Data Poisoning (Đầu độc dữ liệu): Nếu quy trình huấn luyện AI không được kiểm soát chặt chẽ, dữ liệu bẩn hoặc mã độc có thể được đưa vào, làm sai lệch kết quả đầu ra của mô hình.

- Shadow AI (AI “bóng tối”): Nhân viên sử dụng các công cụ AI chưa được bộ phận IT kiểm duyệt, tạo ra những “lỗ đen” về dữ liệu mà doanh nghiệp không thể kiểm soát.

- Đạo đức trí tuệ nhân tạo và trách nhiệm của doanh nghiệp

Mở rộng từ mục “Thách thức khi đào tạo AI” trong tài liệu, việc bảo mật không chỉ là kỹ thuật mà còn là đạo đức trí tuệ nhân tạo. Doanh nghiệp có trách nhiệm:

- Tính minh bạch: Thông báo cho khách hàng biết dữ liệu của họ có được xử lý bởi AI hay không.

- Chống định kiến (Bias): Đảm bảo dữ liệu huấn luyện không chứa các thiên kiến gây phân biệt đối xử, ảnh hưởng đến uy tín thương hiệu.

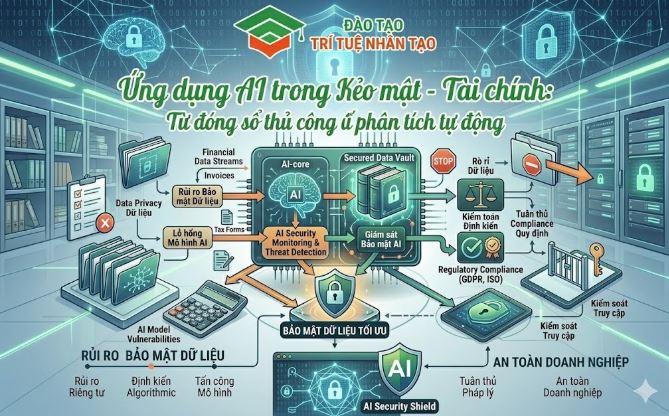

- Giải pháp đột phá: Xây dựng hạ tầng AI nội bộ (Private AI)

Để giải quyết triệt để bài toán bảo mật, xu hướng chuyển dịch mạnh mẽ của năm 2026 là xây dựng Private AI (Hạ tầng AI riêng tư).

Private AI vận hành như thế nào?

Thay vì gửi dữ liệu lên đám mây công cộng, doanh nghiệp triển khai các mô hình ngôn ngữ lớn (như Llama 3, Mistral hoặc các mô hình tùy chỉnh) ngay trên máy chủ nội bộ hoặc trên một phân vùng đám mây riêng biệt (VPC).

Lợi ích của Private AI:

- Dữ liệu không bao giờ rời khỏi hệ thống: Mọi thông tin huấn luyện và câu lệnh đều nằm trong tường lửa của công ty.

- Quyền sở hữu trí tuệ: Các mô hình AI sau khi được huấn luyện bằng dữ liệu đặc thù sẽ trở thành tài sản độc quyền của doanh nghiệp.

- Tuân thủ pháp lý: Đáp ứng các tiêu chuẩn khắt khe về bảo vệ dữ liệu cá nhân (như GDPR hay Nghị định 13 tại Việt Nam).

- Lộ trình 5 bước xây dựng “Pháo đài dữ liệu” AI

- Đánh giá dữ liệu (Data Audit): Phân loại dữ liệu nào được phép đưa vào AI và dữ liệu nào tuyệt đối cấm.

- Làm sạch và ẩn danh (Anonymization): Loại bỏ các thông tin định danh cá nhân (PII) trước khi đưa vào quy trình huấn luyện AI.

- Triển khai mô hình Open-source: Sử dụng các mô hình mã nguồn mở uy tín để tùy chỉnh cho phù hợp với hạ tầng nội bộ.

- Thiết lập hàng rào quản trị (Governance): Xây dựng quy định sử dụng AI rõ ràng và đào tạo nhân viên về an ninh mạng AI.

- Giám sát liên tục: Sử dụng chính các công cụ AI để giám sát các hành vi truy cập dữ liệu bất thường trong hệ thống.

Kết luận: Bảo mật dữ liệu trong kỷ nguyên AI không phải là ngăn cấm nhân viên sử dụng công nghệ, mà là tạo ra một môi trường an toàn để họ khai phá sức mạnh của nó. Việc đầu tư vào Private AI và tuân thủ các nguyên tắc đạo đức trí tuệ nhân tạo chính là tấm khiên vững chắc nhất để doanh nghiệp tiến xa trong năm 2026 mà không lo ngại về rủi ro rò rỉ thông tin.